A medida que los agentes IA se integran más en nuestros terminales e IDEs, el límite entre el "Código Privado" y la "Nube de IA Pública" está desapareciendo. En marzo de 2026, la "Fuga de Prompts" se ha convertido en la principal causa número uno de exposición accidental de datos en empresas tecnológicas emergentes.

Por qué la Configuración de Privacidad "Estándar" no es Suficiente

Muchos desarrolladores confían en los modos de "Chat Temporal". Sin embargo, desde una perspectiva de red, en el momento en que hace clic en "Enviar", sus datos son transmitidos. Si su prompt contiene:

- Claves API Codificadas Directamente: (OpenAI, AWS, Stripe)

- Información Personal Identificable (PII): (Emails de usuarios, números de teléfono, direcciones físicas)

- Datos de Infraestructura Interna: (URLs de bases de datos, direcciones IP internas)

Está confiando en un tercero para gestionar sus activos más sensibles.

4 Niveles de Saneamiento de Prompts

Para trabajar de forma segura con modelos como GPT-5.4 Thinking o Claude 4.6 Opus, debe seguir esta jerarquía de seguridad:

1. La Capa de Redacción (Obligatoria)

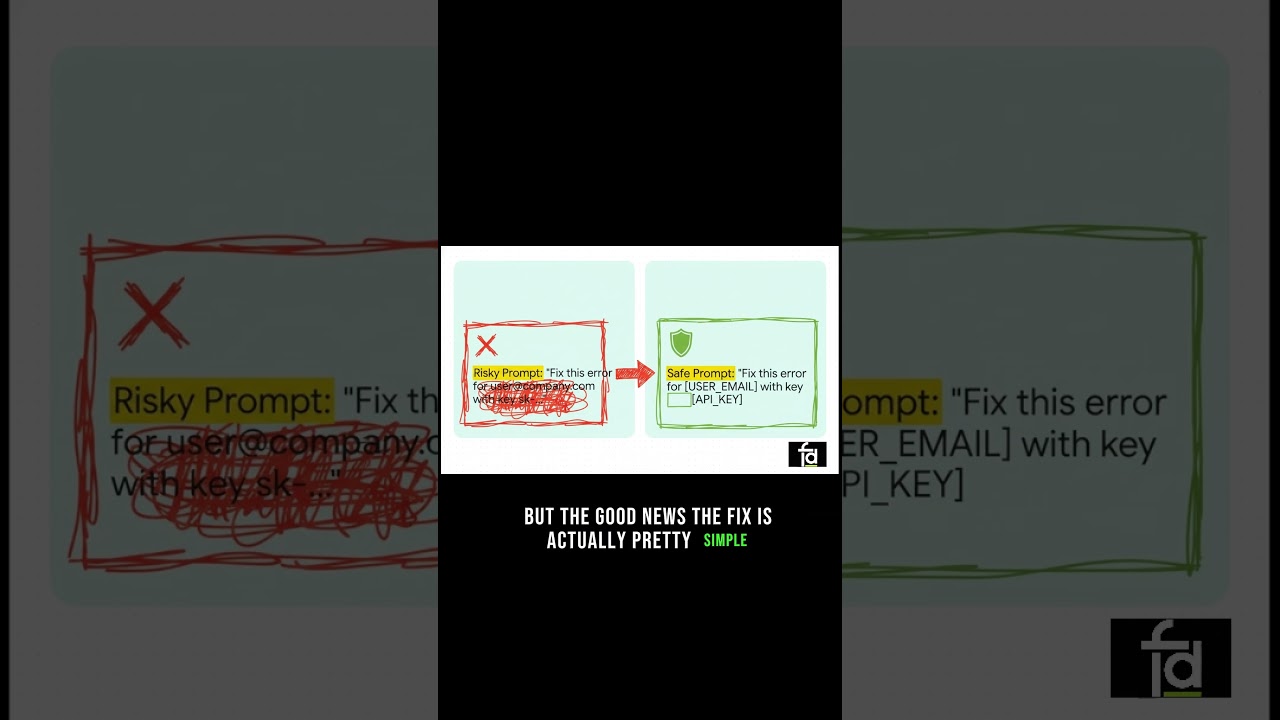

Antes de pegar, reemplace todos los identificadores únicos con etiquetas genéricas.

- En lugar de:

error at user@company.com - Use:

error at [USER_EMAIL]

Esto preserva la lógica para la IA mientras elimina el valor sensible.

2. La Capa de Poda de Contexto

Envíe solo el fragmento de código relevante. No pegue todo el archivo .env solo para corregir una función. Los modelos modernos tienen ventanas de contexto de 1M tokens, pero eso no significa que deba usarlos para secretos.

3. La Verificación Solo-Local

Use una herramienta que funcione 100% en la memoria de su navegador. Si la herramienta tiene un backend, simplemente está trasladando el riesgo de OpenAI a un proveedor de herramientas más pequeño y potencialmente menos seguro.

4. Reforzamiento CSP

Para desarrolladores senior, asegúrese de que las herramientas que usa tengan una Política de Seguridad de Contenido (CSP) estricta que les impida "telefonear" sus datos de vuelta a un servidor.

Lista de Verificación Técnica de Cumplimiento IA para 2026

| Tipo de Dato | Nivel de Riesgo | Acción Recomendada |

|---|---|---|

Claves API (sk-...) | 🔴 Crítico | Redactar automáticamente de forma local |

| Tokens JWT | 🔴 Crítico | Inspeccionar localmente, nunca compartir |

| Emails de Usuarios | 🟡 Alto | Reemplazar con marcadores genéricos |

| Esquemas de Bases de Datos | 🟢 Bajo | Seguro de compartir si se eliminan las claves |

Conclusión: Ingeniería para la Soberanía

En la carrera por la velocidad con IA, no sacrifique la soberanía de sus datos. Al sanear sus entradas localmente, puede usar los modelos de razonamiento más potentes del mundo sin temer jamás una auditoría de seguridad.

👉 Sanee su Prompt Localmente Antes de Enviarlo al LLM