Alors que les agents de l'IA s'intègrent de plus en plus dans notre terminal et nos IDE, la frontière entre "Code Privé" et "Cloud IA Public" disparaît. En mars 2026, la "Fuite de Prompt" est devenue la cause #1 d'exposition accidentelle de données dans les startups tech.

Pourquoi les Paramètres de Confidentialité 'Standards' ne suffisent pas

De nombreux développeurs se reposent sur les modes "Chat Temporaire". Cependant, du point de vue réseau, au moment où vous cliquez sur "Envoyer", vos données sont transmises. Si votre prompt contient :

- Des Clés API Codées en Dur : (OpenAI, AWS, Stripe)

- Des Informations Personnellement Identifiables (PII) : (Emails d'utilisateurs, numéros de téléphone, adresses physiques)

- Des Données d'Infrastructure Interne : (URLs de base de données, adresses IP internes)

Vous faites confiance à un tiers pour gérer vos actifs les plus sensibles.

4 Niveaux d'Assainissement des Prompts

Pour travailler en toute sécurité avec des modèles comme GPT-5.4 Thinking ou Claude 4.6 Opus, vous devez suivre cette hiérarchie de sécurité :

1. La Couche de Masquage (Obligatoire)

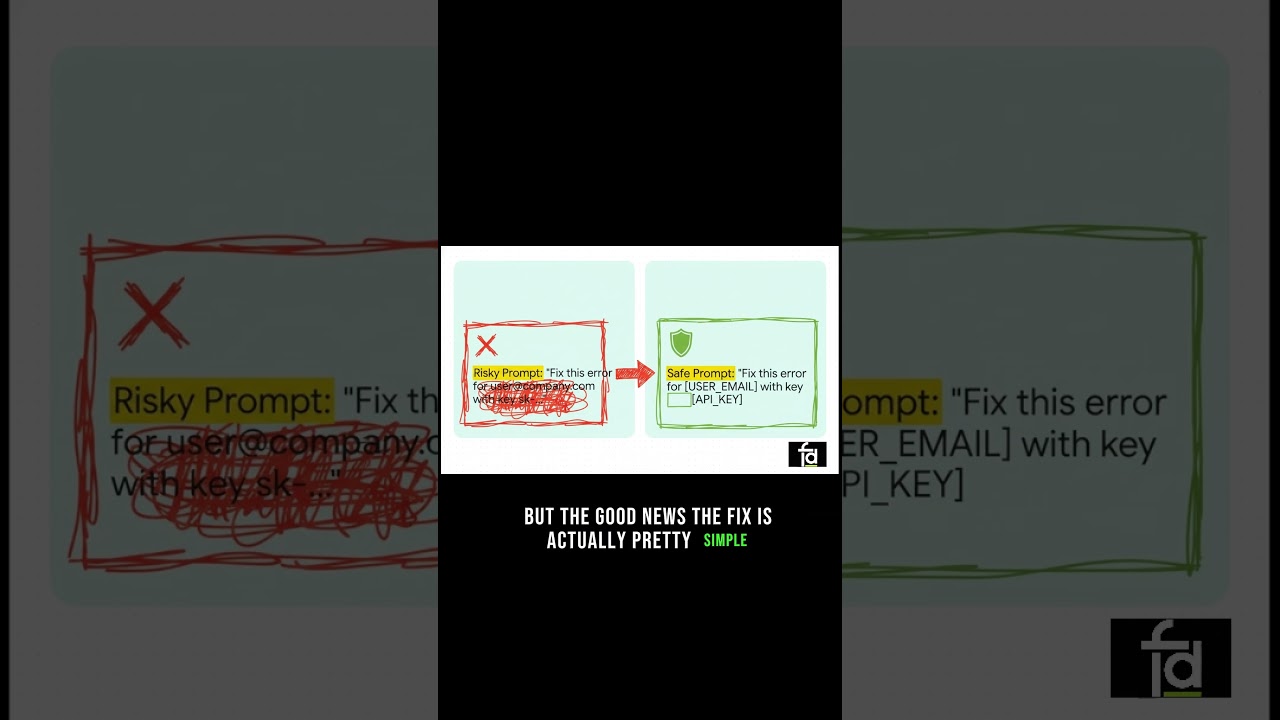

Avant de coller, remplacez tous les identifiants uniques par des balises génériques.

- Au lieu de :

erreur sur user@company.com - Utilisez :

erreur sur [USER_EMAIL]Cela préserve la logique pour l'IA tout en supprimant la valeur sensible.

2. La Couche d'Élagage du Contexte

N'envoyez que le fragment de code pertinent. Ne collez pas tout le fichier .env juste pour corriger une fonction. Les modèles modernes ont des fenêtres de contexte d'1M, mais cela ne signifie pas que vous devriez les utiliser pour des secrets.

3. La Vérification Uniquement Locale

Utilisez un outil qui s'exécute à 100 % dans la mémoire de votre navigateur. Si l'outil possède un backend, vous déplacez simplement le risque depuis OpenAI vers un plus petit fournisseur d'outils, potentiellement moins sécurisé.

4. Renforcement CSP

Pour les développeurs seniors, assurez-vous que les outils que vous utilisez ont une stricte Content Security Policy (CSP) qui les empêche de "téléphoner à la maison" avec vos données vers un serveur.

Checklist Technique pour la Conformité IA 2026

| Type de Données | Niveau de Risque | Action Recommandée |

|---|---|---|

Clés API (sk-...) | 🔴 Critique | Masquer automatiquement localement |

| Tokens JWT | 🔴 Critique | Inspecter localement, ne jamais partager |

| Emails Utilisateurs | 🟡 Élevé | Remplacer par des espaces réservés |

| Schémas de Base de Données | 🟢 Faible | Sûr de partager si les clés sont retirées |

Conclusion : Ingénierie pour la Souveraineté

Dans la course à la vélocité de l'IA, ne sacrifiez pas votre souveraineté des données. En assainissant vos entrées localement, vous pouvez utiliser les modèles de raisonnement les plus puissants du monde sans jamais craindre un audit de sécurité.

👉 Assainissez Votre Prompt Localement Avant de l'Envoyer au LLM